AI, ami tényleg időt spórol a csapatnak.

Úgy építjük az AI-t, mintha pénzügyi rendszer lenne: mérjük, hogy jól válaszol-e, figyeljük mennyibe kerül, és naponta pontosabbá tesszük.

Pozitív hangvétel.

88% bizonyosság · 3 jel

Demo: lexikon-alapú · production: ugyanez az UI Llama / Claude / saját finetune mögött.

Amit megoldunk

- Az AI sokszor hibázik, de nem tudod megmérni, hányszor

- Drágán fut, mert nincs mögötte optimalizálás

- Senki nem meri élesíteni, mert nincs mérce

- Az ügyfélszolgálat elárad a megkeresésekben

Amit kapsz

- AI, ami a saját adataid alapján válaszol · forrásokkal

- Olcsóbb üzemeltetés, automatikusan a legjobb modellt választja

- Automatikus minőség-ellenőrzés minden változás előtt

- Kimutatás: mit kérdeznek, mennyibe kerül, mennyire jó

Konkrétan mit szállítunk

Chatbot a weboldalon, ami ismeri a céged

Levelek és ajánlatok megírása automatikusan

Dokumentumok kereshetővé tétele egy helyen

Saját szerveren futó AI · nem kerül ki semmi

Így dolgozunk

Ugyanaz a kockázatcsökkentő ritmus minden projektben - minden lépésnek mérhető eredménye van.

- 0101 / 04

Adat- és folyamat-átvilágítás

Átnézzük az adataidat, az ügyfélszolgálat / értékesítés / üzemeltetés folyamatait, és kijelöljük, hol tud az AI valódi időt megtakarítani.

- 0202 / 04

Első működő verzió

Az első hét végére kapsz egy próbálható verziót, ami a saját anyagaidból válaszol. Nem csak demó: kipróbáljuk és mérjük is.

- 0303 / 04

Finomhangolás és védőkorlátok

Eszközhívás, útválasztás, korlátozás, személyes adat-szűrés. Minden frissítés előtt automatikus minőségellenőrzés fut.

- 0404 / 04

Éles + finomhangolás

Élesítés, megfigyelés (költség, válaszidő, minőség), heti finomítás a mérések alapján.

Gyakori kérdések

Amit a legtöbben kérdeznek - gyakran még az előtt, hogy felmerülne.

Igen. Megoldható úgy, hogy az adatok ne hagyják el a saját környezetedet (például a saját felhődben vagy szervereden).

Összerakunk egy tesztkészletet a te eseteidből. Minden frissítés előtt automatikus ellenőrzések futnak, és kapsz egy egyszerű kimutatást arról, hogy javult-e a minőség vagy romlott.

Pilot 2-4 hét alatt. Termelés 4-12 hét alatt, komplexitástól függően. Ha gyorsan mérhető KPI-t akarsz, 6 hét reális.

Úgy építjük meg, hogy a saját anyagaidból válaszoljon, forrással. Ha nem biztos benne, inkább kérdez vagy nemet mond. A hibák nagy része megelőzhető, a maradékot pedig mérjük és figyeljük.

Pilot 4 000 €-tól, éles fejlesztés 15 000-60 000 € a feladat méretétől függően, beépített csapat 9 000 €/hó-tól. Egy ingyenes 30 perces hívás után fix árat adunk · nincs nyitott végű óradíj.

Igen, pontosan ez a lényeg. A PDF-jeiteket, leírásaitokat, korábbi ügyfélleveleket és szerződéseket - magyarul vagy angolul - feldolgozzuk, és az AI ezekből keres vissza. Az adataitok nem kerülnek be egy nyilvános modell tanításába.

Minden a tiétek: a kód, a beállítások, az infrastruktúra. Adunk egy üzemeltetési leírást, és vagy maradunk havi keretben a finomhangoláshoz, vagy tisztán kilépünk. Nincs licencdíj, nincs kötöttség.

Szállított projektek

202601 / 04Weboldal · Egyedi szoftverfejlesztés · AI fejlesztés

202601 / 04Weboldal · Egyedi szoftverfejlesztés · AI fejlesztésA Vilya Protection egy közéleti szereplők és nagyrendezvények védelmére tervezett SaaS. Valós idejű fenyegetés-értékelés, taktikai vezérlő-felület, 3D térbeli vizualizáció, menekítési útvonal-tervezés. A csapat egy LinkedIn-üzenettel keresett meg minket. Egy hetes brief és két apró módosítás után élesedett a publikus oldal és a demo-felület.

amit szállítottunk- Valós idejű fenyegetés-értékelés és súlyossági besorolás

- Taktikai dashboard biztonsági szolgálatoknak

- 3D-s helyszín-vizualizáció és menekítési útvonal-tervezés

amit használtunkNext.jsTypeScriptThree.jsWebGL 202602 / 04Egyedi szoftverfejlesztés · Weboldal · AI fejlesztés

202602 / 04Egyedi szoftverfejlesztés · Weboldal · AI fejlesztésAz AutoImport beszívja az EU-s B2B autóaukciók Buy-Now tételeit, valódi magyar használtautó-hirdetésekkel hasonlítja össze, és csak azokat hozza ki, ahol a marzs az összes költséget bírja - szállítás, vevői díj, magyar regisztrációs adó. Új deal-ek lapozható fotó-carousel formájában érkeznek egy privát Telegram-csatornára.

amit szállítottunk- Élő EU aukció-scraper (Openlane Buy-Now)

- Magyar használtautó-hirdetésekkel comp-olva

- Landed-cost marzs · szállítás + díj + regadó

amit használtunkNext.jsTypeScriptPostgresPlaywrightTelegram 202603 / 04AI fejlesztés · Weboldal · Egyedi szoftverfejlesztés

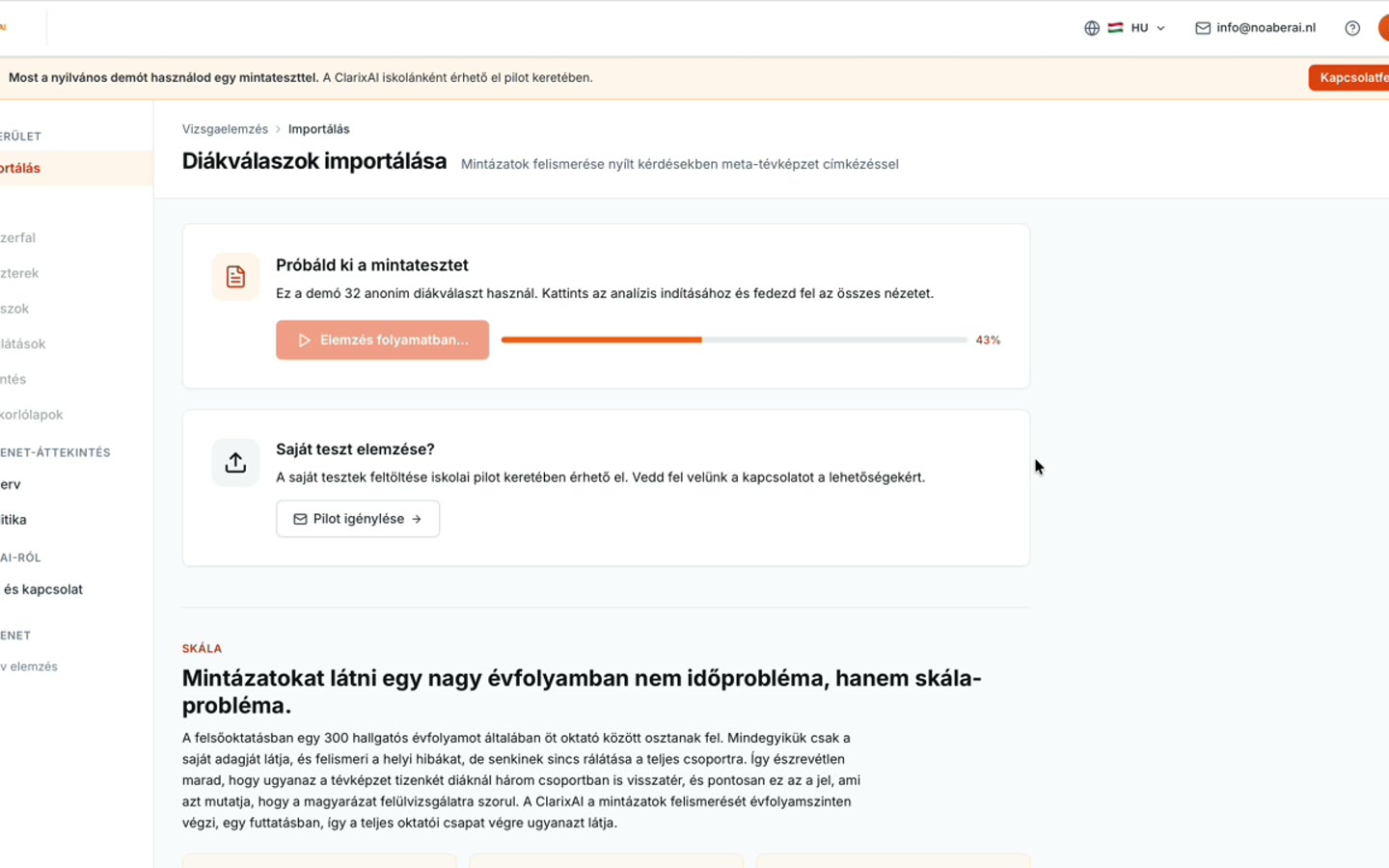

202603 / 04AI fejlesztés · Weboldal · Egyedi szoftverfejlesztésA ClarixAI olvassa a nyitott diákválaszokat (holland, angol, magyar) és kiteszi az osztályt uraló tévhit-mintázatokat - fogalom-keverés, felszíni mintázat, hiányzó előfeltétel, és hat további - mintázatonként konkrét pedagógiai akció-kártyával. Nem osztályozza a diákot; az osztály gondolkodását minősíti. Per-nyelvű, multi-task transformer ensemble plusz HDBSCAN-klaszterezés talál strukturális mintát kérdéseken keresztül.

amit szállítottunk- Multi-task tévhit-klasszifikátor · NL · EN · HU

- 8 gondolkodási-hiba meta-címke · tanári akcióval címkénként

- HDBSCAN-klaszterezés kérdéseken átívelő strukturális mintára

amit használtunkPythonPyTorchTransformersFastAPIReact 202604 / 04AI fejlesztés · Weboldal · Mobilapp fejlesztés

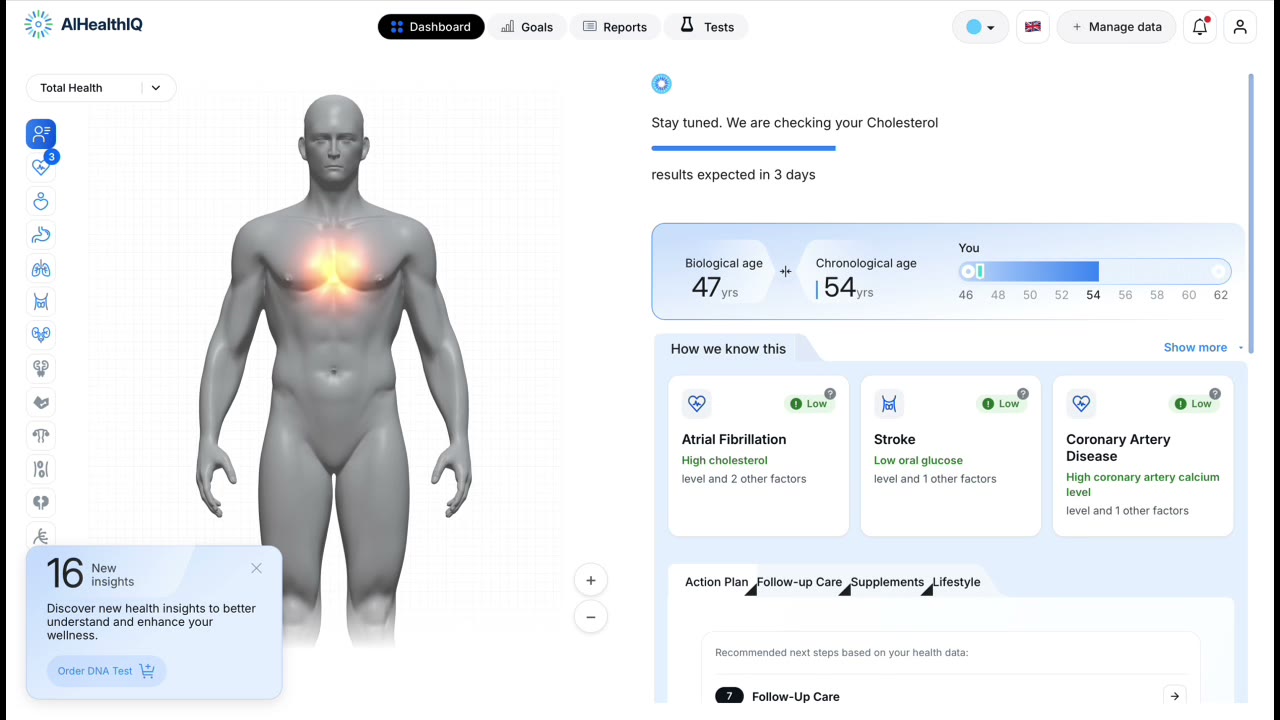

202604 / 04AI fejlesztés · Weboldal · Mobilapp fejlesztésOlvassa az okos-órák, fitness-karkötők és más források adatait (szívritmus, alvás, lépésszám, oxigénszint), AI-val korrelálja, és javaslatot tesz kezelésre, gyógyszerre vagy életmód-váltásra. Webes és mobil felület, API is elérhető.

amit szállítottunk- Wearable-adat olvasás (órák, karkötők)

- AI-elemzés és trendfigyelés

- Kezelési és életmód-javaslat

amit használtunkExpressReact-ReduxSQLiteOpenRouter

AI fejlesztés · helyszínenként

Budapesti stúdió · az alábbi városokba és régiókba szállítunk, távolról, on-site igény szerint.

Kezdjünk bele.

Írj egy e-mailt vagy foglalj egy 30 perces hívást.

További szolgáltatások